Erkennen und benennen zu können, wer oder was auf einem Bild zu sehen ist, ist schon lange keine exklusiv menschliche Fähigkeit mehr. Denn die Maschinen lernen momentan schnell dazu: Facebooks Gesichtserkennungs-Software DeepFace, die Anfang 2015 weltweit (außer in der EU because of Datenschutz) implementiert wurde, soll in der Lage sein, mit 97%-iger Genauigkeit Freunde auf Fotos zu taggen – automatisch. (Die Gesichtserkennungssoftware des FBI arbeitet übrigens mit 85%-iger Genauigkeit.) Und bei Google Photos kann man seine Bilder durchsuchen, indem man einfach eingibt, was auf ihnen zu sehen ist.

Die Technologie, die diese Magie möglich macht, nennt sich Deep Learning. Stark vereinfacht ausgedrückt wird ein Computer darauf trainiert, Muster in (digitalen) Bildern zu erkennen, indem man ihm eine große Menge an Bilddaten mit entsprechenden Referenzen zur Verfügung stellt, nach dem Schema: “Das hier sind 4000 verschiedene Bilder und sie alle zeigen das gleiche Objekt, das als XYZ definiert ist.” Und wenn wir hier von “Computer” reden, reden wir natürlich nicht vom 300-Euro-PC ausm Aldi, sondern von sogenannten künstlichen neuronalen Netzen, also hochkomplexen Architekturen aus vielen, vielen Prozessoren, die grob gesagt versuchen, die Struktur und Verschaltung des menschlichen Gehirns nachzuahmen. Eine künstliche Intelligenz also.

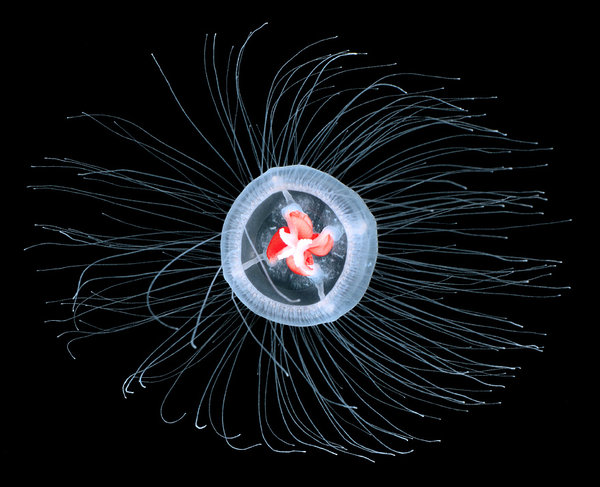

Wenn man nun diesen Deep Neural Networks (DNNs), die darauf trainiert sind, den Inhalt eines Fotos zu erfassen, die Aufgabe stellt “Erstelle ein Bild von Objekt XYZ”, spricht man von sog. Deep Generator Networks (DGNs): Die KI schaut sich nicht mehr nur Bilder an, sondern erschafft selbst welche. Wir können sehen, woran die KI denkt, besser gesagt, was sie “sieht”, wenn sie z. B. an einen Cheeseburger “denkt”. Und nicht nur das: Wir können auch bei der Entstehung des Bilds zusehen. Genau das haben Wissenschaftler der University of Wyoming und der Universität Freiburg jetzt getan. Ergebnis: Die KI wirft so lange scheinbar wilde Muster und Texturen zusammen, bis etwas dabei rauskommt, das wie ein Cheeseburger aussieht. Gene Kogan hat ein Video des Prozesses bei Twitter hochgeladen:

watching DGN samples form. they jostle wildly through a generative space until converging on… a cheeseburger pic.twitter.com/yEKsTgMweu

— Gene Kogan (@genekogan) August 29, 2016

Und hier noch eins von einer Teekanne:

one more: a teapot, as an homage to last month's @siggraph pic.twitter.com/8oJudScoDU

— Gene Kogan (@genekogan) August 29, 2016

René hat sich außerdem die Mühe gemacht und die einzelnen Frames der Cheeseburger-Entstehung visualisiert. Man kann schön sehen, dass das alles gar nicht so chaotisch ist, wie es zunächst aussieht:

Selbst einmal mit einem echten Deep Generator Network rumspielen könnt ihr mit Googles Deep Dream Generator. Ich hab mal das deep generierte Burger-Bild von der Google-KI deep dreamen lassen und heraus kam das:

Mehr Meta geht nicht.

[>> Zur Publikation des KI-Cheeseburger-Forscherteams]